STF: Redes sociais respondem por posts mesmo sem ordem judicial; veja tese

Ministros declararam parcialmente inconstitucional o art. 19 do marco civil da internet.

Da Redação

quinta-feira, 26 de junho de 2025

Atualizado em 27 de junho de 2025 08:20

Nesta quinta-feira, 26, o STF, por maioria de oito votos a três, reconheceu a inconstitucionalidade parcial do art. 19 do marco civil da internet (lei 12.965/14), que condicionava a responsabilização civil das plataformas digitais à existência de prévia ordem judicial para remoção de conteúdo.

Apenas os ministros André Mendonça, Edson Fachin e Nunes Marques divergiram, considerando o dispositivo constitucional e, por isso, posicionaram-se contra a tese aprovada pela maioria.

O julgamento ocorreu no âmbito de dois recursos extraordinários com repercussão geral reconhecida: RE 1.037.396 (Tema 987) e RE 1.057.258 (Tema 533).

Ao firmar entendimento, o STF concluiu que o modelo atual, embora assegure a liberdade de expressão, não garante de forma suficiente a proteção de direitos fundamentais e da própria democracia, diante da ampla disseminação de conteúdos ilícitos no ambiente digital.

A tese afirma que o art. 19 do Marco Civil não é plenamente compatível com a CF: ainda que parcialmente válido, o dispositivo deixa de resguardar de modo adequado bens jurídicos essenciais, como a dignidade da pessoa humana, os direitos de mulheres, crianças, minorias, além do regular funcionamento das instituições democráticas.

Para o STF, há uma omissão legislativa parcial, uma vez que o Congresso ainda não instituiu um regime jurídico capaz de enfrentar, com eficácia, os desafios da era digital e seus impactos sobre os direitos fundamentais.

Veja o placar:

Entenda a decisão

A partir de agora, os provedores poderão ser responsabilizados mesmo sem decisão judicial nas seguintes situações:

- Conteúdos impulsionados ou pagos, inclusive por robôs ou redes artificiais de distribuição;

- Casos de circulação massiva de conteúdos gravíssimos, como: atos antidemocráticos (ex: tentativa de golpe); terrorismo; indução ao suicídio ou automutilação; discurso de ódio racial, religioso, sexual, de gênero ou contra mulheres; pornografia infantil, crimes sexuais contra vulneráveis, e tráfico de pessoas.

Nessas hipóteses, os provedores devem agir imediatamente para remover os conteúdos ilícitos, sob pena de responderem civilmente. A omissão configura "falha sistêmica", especialmente se não adotarem medidas preventivas e tecnicamente eficazes.

Outros casos

A decisão também especifica como o art. 19 deve ser interpretado em contextos distintos:

- Crimes contra a honra: permanece a exigência de ordem judicial, mas admite-se remoção por notificação extrajudicial.

- Repetição de conteúdo ofensivo já declarado ilícito por decisão judicial: as plataformas devem remover novas postagens idênticas sem necessidade de nova ordem judicial, após notificação.

- Provedores de e-mail, reuniões privadas e mensageria pessoal (como WhatsApp): continuam protegidos pela regra original do art. 19, por envolverem comunicações privadas protegidas constitucionalmente.

- Marketplaces (plataformas de comércio eletrônico): responderão conforme o CDC.

Medidas práticas

Todos os provedores deverão implementar:

- Autorregulação obrigatória (com sistemas de notificação, devido processo e relatórios de transparência);

- Canais acessíveis de atendimento a usuários e terceiros;

- Representação jurídica no Brasil com poderes plenos para responder judicial e administrativamente.

Natureza da responsabilidade e modulação

A responsabilidade não é objetiva: será preciso demonstrar falha de conduta ou omissão sistêmica por parte da plataforma.

Para garantir segurança jurídica, o STF modulou os efeitos da decisão, que só valerá para fatos futuros. Estão ressalvadas as ações já transitadas em julgado.

Além disso, a Corte fez um apelo ao Congresso Nacional para que elabore nova legislação que preencha as lacunas identificadas, oferecendo equilíbrio entre liberdade de expressão e proteção de direitos fundamentais.

Veja a íntegra da tese:

"Reconhecimento da inconstitucionalidade parcial e progressiva do artigo 19 do marco civil da internet, MCI.

1. O artigo 19 da lei nº 12.965/2014, marco civil da internet, que exige ordem judicial especial específica para a responsabilização civil de provedor de aplicações de internet por danos decorrentes de conteúdo gerado por terceiros, é parcialmente inconstitucional. Há um estado de omissão parcial que decorre do fato de que a regra geral do artigo 19 não confere proteção suficiente a bens jurídicos constitucionais de alta relevância, proteção de direitos fundamentais e da democracia.

Interpretação do artigo 19 do MCI.

2. Enquanto não sobrevier nova legislação, o artigo 19 do MCI deve ser interpretado de forma que os provedores de aplicação de internet estão sujeitos à responsabilização civil ressalvada à aplicação das disposições específicas da legislação eleitoral e os atos normativos expedidos pelo Tribunal Superior Eleitoral (TSE).

3. O provedor de aplicações de internet será responsabilizado civilmente, nos termos do artigo 21 do MCI, pelos danos decorrentes de conteúdo gerados por terceiros em casos de crime ou atos ilícitos, sem prejuízo do dever de remoção do conteúdo. Aplica-se a mesma regra nos casos de contas denunciadas como inautênticas.

3.1. Nas hipóteses de crime contra a honra, aplica-se o artigo 19 do MCI, sem prejuízo da possibilidade de remoção por notificação extrajudicial.

3.2. Em se tratando de sucessivas replicações do fato ofensivo já reconhecido por decisão judicial, todos os provedores de redes sociais deverão remover as publicações com idênticos conteúdos, independentemente de novas decisões judiciais, a partir de notificação judicial ou extrajudicial.

Presunção de responsabilidade.

4. Fica estabelecida a presunção de responsabilidade dos provedores em casos de conteúdos ilícitos quando se tratar de: (a) anúncios e impulsionamentos pagos; ou (b) rede artificial de distribuição chatbots ou robôs. Nestas hipóteses, a responsabilização poderá se dar independentemente de notificação. Os provedores ficarão excluídos de responsabilidade se comprovarem que atuaram diligentemente e em tempo razoável para tornarem disponível o conteúdo.

Dever de cuidado em caso de circulação massiva de conteúdos ilícitos graves

5. O provedor de aplicações de internet é responsável quando não promover a indisponibilização imediata de conteúdos que configurem as práticas de crimes graves previstos no seguinte rol taxativo:

a. Condutas e atos antidemocráticos que se amoldem aos tipos previstos nos artigos 296, parágrafo único, 359-L, 359-M, 359-N, 359-P e 359-R do Código Penal.

b. Crimes de terrorismo ou preparatórios de terrorismo tipificados pela lei nº 13.260/2016.

c. Crimes de induzimento, instigação ou auxílio a suicídio ou a automutilação nos termos do art. 122 do Código Penal.

d. Incitação à discriminação em razão de raça, cor, etnia, religião, procedência nacional, sexualidade ou identidade de gênero.

e. Condutas homofóbicas e transfóbicas passível de enquadramento nos artigos 20, 20A, 20B e 20C da Lei nº 7.716, de 1989.

f. Crimes praticados contra a mulher em razão da condição do sexo feminino, inclusive conteúdos que propagam ódio às mulheres. (art. 147 § 1º, Art. 147A e Art. 147-B do Código Penal).

g. Crimes sexuais contra pessoas vulneráveis, pornografia infantil e crimes graves contra crianças e adolescentes, nos temos dos artigos 217-A, 218, 218-A, 218-B, 218-C do Código Penal e dos artigos 240, 241-A, 241-C, 241-D do Estatuto da Criança e do Adolescente.

h. Tráfico de pessoas (Código Penal, art. 149-A).

5.1. A responsabilidade dos provedores de aplicações de internet prevista neste item diz respeito à configuração de falha sistêmica.

5.2. Considera-se falha sistêmica imputável ao provedor de aplicações de internet deixar de adotar adequadas medidas de prevenção ou remoção dos conteúdos ilícitos anteriormente listados, configurando violação ou dever de atuar de forma responsável, transparente e cautelosa.

5.3. Consideram-se adequadas as medidas que, conforme o estado da técnica, forneçam os níveis mais elevados de segurança para o tipo de atividade desempenhada pelo provedor.

5.4. A existência de conteúdo ilícito de forma isolada, atomizada, não é por si só suficiente para ensejar a aplicação da responsabilidade civil do presente item. Contudo, nesta hipótese, incidirá o regime de responsabilidade previsto no artigo 21 do marco civil da internet.

5.5. Nas hipóteses previstas neste item, o responsável pela publicação do conteúdo removido pelo provedor de aplicações de internet poderá requerer judicialmente o seu restabelecimento, mediante demonstração da ausência de ilicitude. Ainda que o conteúdo seja restaurado por ordem judicial, não haverá imposição de indenização ao provedor.

Incidência do artigo 19.

6. Aplica-se o artigo 19 do MCI ao:

a. Provedor de serviços de e-mail;

b. Provedor de aplicações cuja finalidade primordial seja a realização de reuniões fechadas por vídeo ou voz;

c. Provedor de serviços de mensageria instantânea;

d. Provedores de serviços de mensageria privada, exclusivamente no que diz respeito às comunicações interpessoais resguardadas pelo sigilo das comunicações da Constituição Federal de 1988

Marketplaces

7. Os provedores de aplicações de internet que funcionarem como marketplaces respondem civilmente de acordo com o Código de Defesa do Consumidor (lei nº 8.078/1990)

Deveres adicionais

8. Os provedores de aplicações de internet deverão editar autorregulação que abranja, necessariamente, sistema de notificações devido processo e relatórios anuais de transparência em relação a notificações extrajudiciais, anúncios e impulsionamentos

9. Deverão, igualmente, disponibilizar a usuários e a não-usuários canais específicos de atendimento, preferencialmente eletrônicos, que sejam acessíveis e amplamente divulgados nas respectivas plataformas de maneira permanente

10. Tais regras deverão ser publicadas e revisadas periodicamente de forma transparente e acessível ao público

11. Os provedores de aplicações de internet com atuação no Brasil devem constituir e manter sede e representante no país, cuja identificação e informações para contato deverão ser disponibilizadas e estar facilmente acessíveis nos respectivos sítios

12. Essa representação deve conferir ao representante, necessariamente pessoa jurídica com sede no país, plenos poderes para:

a. Responder perante as esferas administrativa e judicial;

b. Prestar às autoridades competentes informações relativas ao funcionamento do provedor, às regras e aos procedimentos utilizados para a moderação de conteúdo e para a gestão das reclamações pelos sistemas internos

c. Aos relatórios de transparência, monitoramento e gestão dos riscos sistêmicos;

d. As regras para o perfilamento de usuários, quando for o caso, a veiculação de publicidade e o impulsionamento remunerado de conteúdos

e. Cumprir as determinações judiciais;

f. Responder e cumprir eventuais penalizações, multas e afetações financeiras em que o representado incorrer, especialmente por descumprimento de obrigações legais e judiciais

Natureza da responsabilidade

12. Não haverá responsabilidade objetiva na aplicação da tese aqui enunciada.

Apelo ao legislador

13. Apela-se ao Congresso Nacional para que seja elaborada legislação capaz de sanar as deficiências do atual regime quanto à proteção de direitos fundamentais modulação dos efeitos temporais.

14. Para preservar a segurança jurídica, ficam modulados os efeitos da presente decisão que somente se aplicará prospectivamente, ressalvadas decisões transitadas em julgado."

Assista à prolação da tese:

Votos divergentes

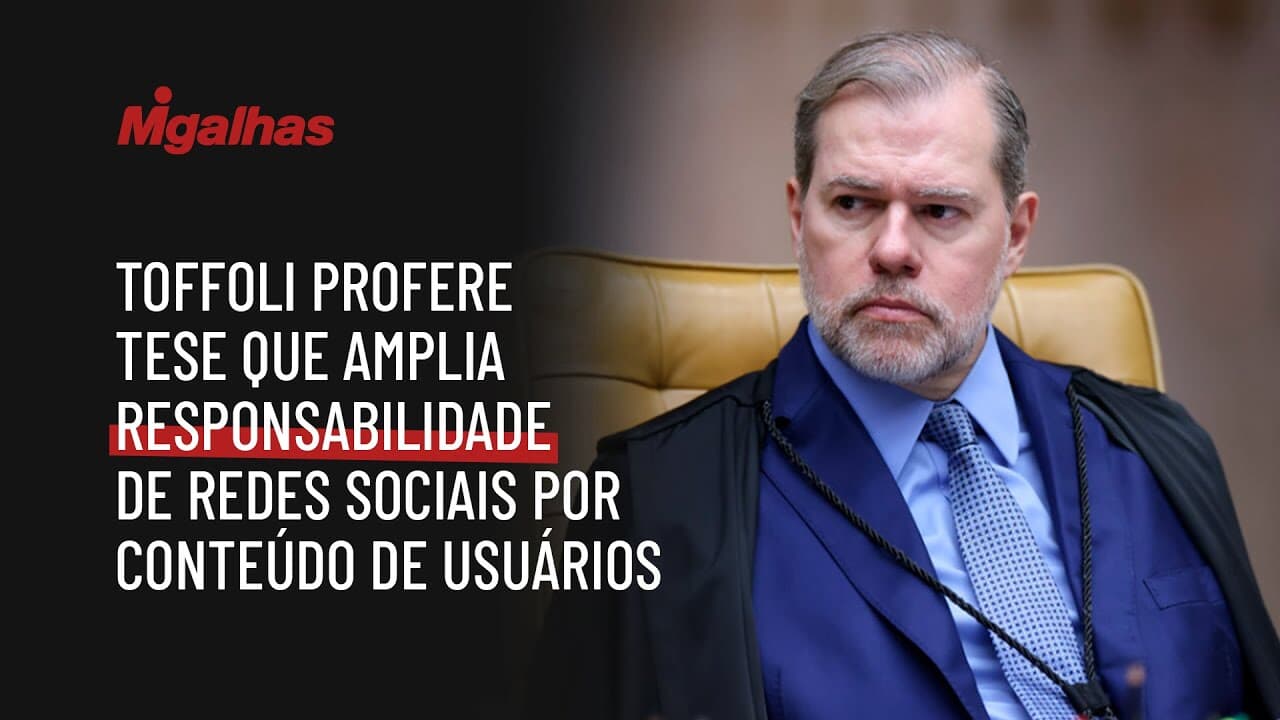

Esta foi a última sessão plenária em que o STF tratou do tema, mas o debate se arrasta, ao menos, desde o final de 2024, quando o ministro Dias Toffoli, relator de uma das ações, apresentou o primeiro voto.

Na sessão desta quinta-feira, 26, após a manifestação do ministro Nunes Marques - o último a votar -, foi finalmente proclamada a tese de repercussão geral.

Segundo informou o presidente da Corte, ministro Luís Roberto Barroso, houve necessidade de construção de um consenso entre os ministros, nos bastidores da sessão, para compatibilizar os diferentes posicionamentos.

Confira, na tabela a seguir, um resumo do voto de cada ministro:

Casos concretos

No RE 1.037.396, de relatoria do ministro Dias Toffoli, o plenário, por maioria, negou provimento ao recurso extraordinário interposto contra acórdão que reconheceu a responsabilidade da plataforma por danos decorrentes de conteúdo ofensivo. O único voto vencido foi o do ministro Luiz Edson Fachin, que defendia a reforma da decisão anterior.

Já no RE 1.057.258, sob relatoria do ministro Luiz Fux, o Supremo, por maioria, deu provimento ao recurso extraordinário apresentado pela empresa Google do Brasil, afastando a condenação ao pagamento de indenização por danos morais imposta pela 1ª turma recursal de Belo Horizonte/MG.

Prevaleceu, nesse segundo caso, o voto do ministro André Mendonça, o primeiro a divergir e defender a reforma da decisão. Foram vencidos os ministros Luiz Fux (relator), Dias Toffoli, Alexandre de Moraes e Nunes Marques, que votaram pelo desprovimento do recurso e, portanto, pela manutenção da condenação.

Pela inconstitucionalidade - I

Em dezembro de 2024, o relator Dias Toffoli votou pela declaração de inconstitucionalidade do art. 19. Para S. Exa., a norma concede imunidade excessiva às plataformas, favorecendo a disseminação de conteúdos nocivos. Defendeu que o mesmo rigor jurídico aplicado ao mundo físico deve prevalecer no ambiente digital.

Toffoli propôs a responsabilização objetiva em casos graves, como perfis falsos ou ameaças à integridade eleitoral, admitindo notificações extrajudiciais como suficientes.

Ressalvou, porém, que e-mails, ferramentas de reuniões online e blogs jornalísticos devem seguir regimes próprios - no caso da imprensa, a lei do direito de resposta (lei 13.188/15).

Também defendeu a possibilidade de aplicação retroativa da responsabilização, em nome da proteção de direitos fundamentais.

Pela inconstitucionalidade - II

Na mesma linha, Luiz Fux considerou o art. 19 inconstitucional, criticando o modelo que condiciona a responsabilidade à ordem judicial específica.

Ressaltou que, diferentemente da imprensa tradicional, as plataformas não se submetem a mecanismos de verificação prévia, o que favorece a propagação de danos à dignidade humana.

Fux defendeu que, diante da evidência da ilicitude ou após notificação idônea, as plataformas devem ser responsabilizadas. Em casos como racismo, pedofilia ou apologia ao golpe de Estado, sustentou que as empresas têm o dever de monitoramento ativo. Já em relação a conteúdos que ferem honra ou privacidade, sugeriu responsabilização após notificação fundamentada.

Além disso, afirmou que, quando o conteúdo ofensivo é impulsionado por pagamento, presume-se o conhecimento da ilicitude por parte da plataforma.

Posição intermediária

Ministro Luís Roberto Barroso propôs solução de equilíbrio. Embora reconheça a inconstitucionalidade parcial do art. 19, sugeriu ajustes que mantenham a regra geral com exceções ampliadas.

Propôs um sistema dual: de um lado, responsabilidade subjetiva para conteúdos gerados por terceiros; de outro, dever de cuidado em relação a riscos sistêmicos, como pornografia infantil, tráfico de pessoas e terrorismo.

Para crimes contra a honra, defendeu a exigência de ordem judicial como salvaguarda à liberdade de expressão. Para os demais ilícitos, admitiu a remoção com base em notificação privada.

Barroso também apelou ao Congresso Nacional para aprovar um marco regulatório que discipline a mitigação de riscos sistêmicos, com exigência de auditorias, relatórios e supervisão por órgão autônomo.

Enquanto isso não ocorre, sugeriu que as plataformas publiquem relatórios anuais de transparência, nos moldes do Digital Services Act europeu.

Por fim, previu deveres anexos como canal de comunicação, devido processo e relatórios de transparência.

Voto-vista

No voto-vista apresentado em 5/6/24, ministro André Mendonça propôs atualização do paradigma jurídico da liberdade de expressão para o contexto digital, defendendo regulação segmentada conforme o tipo de serviço (como redes sociais, aplicativos de mensagem e marketplaces) e baseada em deveres de diligência, não em resultados.

Crítico à moderação automatizada, alertou para riscos de censura indireta e defendeu que a responsabilização das plataformas deve se pautar por procedimentos e governança, e não por conteúdos isolados.

Propôs modelo de autorregulação regulada, com compliance e transparência, capaz até de afastar a responsabilidade das empresas.

Também destacou que a suspensão de perfis só deve ocorrer com base legal ou judicial, como exceção, em respeito ao devido processo e à personalidade digital do indivíduo.

Proteção insuficiente

Em 11/6/25, ministro Cristiano Zanin votou pela inconstitucionalidade parcial - ou interpretação conforme - do art. 19 do marco civil da internet.

Para S. Exa., ao exigir ordem judicial para responsabilizar provedores, o dispositivo oferece proteção insuficiente frente aos direitos fundamentais ameaçados pela disseminação de conteúdos ilícitos.

Zanin criticou premissas que embasaram a norma, como a suposta neutralidade das plataformas e a eficácia da autorregulação. Segundo ele, essas premissas não se confirmaram: algoritmos e políticas de engajamento reforçam a circulação de desinformação, comprometendo o Estado Democrático de Direito.

Ressaltou que a liberdade de expressão não é absoluta e que a literalidade do art. 19 viola o princípio da proporcionalidade. Sugeriu modelo de responsabilidade subjetiva diferenciada: provedores ativos responderiam após notificação (art. 21), enquanto provedores neutros e imprensa, apenas após decisão judicial.

Aderiu aos deveres de cuidado propostos por Toffoli e defendeu que plataformas devem prevenir riscos sistêmicos.

Também propôs modulação dos efeitos para que a nova interpretação só se aplique a fatos futuros. Nos casos concretos, votou por afastar a condenação do Facebook, dado o marco temporal da modulação.

Tecnodeterminismo

Ministro Flávio Dino criticou o impacto social das redes sociais e defendeu um modelo constitucional de liberdade baseado na responsabilidade.

Para S. Exa., a ideia de que qualquer regulação compromete a liberdade de expressão é "absolutamente falsa" e distorce o liberalismo clássico, que também prevê limites a poderes privados abusivos.

Dino compartilhou experiências pessoais, como o episódio dos ataques a escolas em 2023 e a leitura de um livro sobre os riscos da internet para adolescentes, para ilustrar a urgência de uma regulação eficaz.

Afirmou que consultou a Meta IA e, que, a partir da resposta da tecnologia, "até o algoritmo sabe" que liberdade sem responsabilidade representa um perigo - e que não há espaço para autorregulação privada sem controle constitucional.

Novo regramento

Ao votar, ministro Gilmar Mendes defendeu a superação do modelo de responsabilidade mitigada das plataformas digitais e propôs um novo marco regulatório.

Segundo o decano da Corte, gigantes como Google, Facebook e Amazon deixaram de ser meras transmissoras de conteúdo e atuam hoje como verdadeiros reguladores do discurso público.

"O paradigma de neutralidade com relação ao conteúdo foi completamente superado", afirmou Gilmar, ao destacar que essas plataformas interferem ativamente na circulação de informações, promovendo ou restringindo conteúdos por meio de algoritmos.

Essa atuação, disse o ministro, não é neutra, mas orientada por modelos de negócio voltados à maximização do engajamento e à monetização da atenção dos usuários.

Gilmar endossou os votos dos ministros Toffoli, Fux, André Mendonça, Flávio Dino e Cristiano Zanin, para quem o art. 19 - que condiciona a responsabilização das plataformas à existência de ordem judicial - tornou-se defasado.

Para S. Exa., a autorregulação atualmente praticada pelas plataformas é insuficiente. Propôs, por isso, quatro regimes distintos de responsabilização, a depender do grau de interferência da plataforma sobre o conteúdo:

- Regime residual - Mantém a necessidade de ordem judicial apenas para conteúdos jornalísticos e crimes contra a honra.

- Regime geral - Responsabiliza a plataforma que, notificada, se omite diante de conteúdo ilícito, inclusive quando não remove conteúdos idênticos a outros já removidos por decisão judicial.

- Regime de presunção - Presume responsabilidade da plataforma por conteúdos veiculados em anúncios pagos e impulsionamentos, dispensando notificação.

- Regime especial - Prevê responsabilização solidária pela não remoção imediata de conteúdos e contas que divulguem crimes graves, como atos antidemocráticos, discurso de ódio, ameaças à Justiça Eleitoral, incitação ao suicídio ou terrorismo.

Além disso, o ministro defendeu a criação de um órgão regulador - com destaque para a ANPD - para fiscalizar obrigações procedimentais como relatórios de transparência, sistemas de notificação, repositórios de anúncios e canais de recurso para usuários atingidos por medidas de moderação.

Impunidade

Em 12/6/25, ministro Alexandre de Moraes ao votar, defendeu a responsabilização das plataformas digitais e criticou a ideia de que as big techs estariam acima das leis nacionais.

Para o ministro, as redes sociais deixaram de ser meras intermediárias tecnológicas e devem ser tratadas como empresas de comunicação, sujeitas aos mesmos deveres constitucionais.

"Temos que nos perguntar se as big techs possuem uma cláusula absoluta de impunidade", disse, ao argumentar que a liberdade de expressão não pode ser usada como escudo para práticas criminosas.

Moraes exibiu publicações racistas e homofóbicas no telão do plenário, afirmando:

"Isso não é utilização da liberdade de expressão, isso é crime."

O ministro também rebateu críticas que classificam a regulação como autoritária e invocou a obra de John Stuart Mill para demonstrar que a liberdade de expressão não é absoluta.

"Dizem que somos ditadores porque queremos cercear o chamado mercado livre de ideias, idealizado por John Stuart Mill. E quem diz isso jamais leu John Stuart Mill", ironizou.

Segundo S. Exa., há consenso na Corte de que o art. 19 deve ser reinterpretado à luz dos princípios constitucionais e da realidade tecnológica.

O ministro defendeu que a Corte adote interpretação constitucional condizente com os avanços tecnológicos e com a proteção dos direitos fundamentais. Segundo Moraes, redes sociais e serviços de mensageria privada têm sido utilizados para alimentar "inconstitucionalização silenciosa", promovida por discursos de ódio, desinformação e manipulação digital.

Moraes argumentou que o modelo atualmente adotado - no qual as plataformas se limitam a alegar que apenas intermediam conteúdos - tornou-se insustentável diante da complexidade tecnológica.

Defendeu ainda que as plataformas tenham sede no Brasil, adotem transparência algorítmica e mecanismos preventivos para evitar manipulações - a exemplo da regulação vigente na União Europeia.

Portão de papelão

Ministra Cármen Lúcia, em 25/6/25, defendeu a responsabilização das plataformas digitais nos casos em que houver descumprimento de ordens judiciais para retirada de conteúdos ilícitos.

A ministra criticou a ineficácia do atual regime legal frente à dinâmica das redes sociais que têm operado como "cavalo de Troia", apto a violar garantias fundamentais do Estado Democrático de Direito, sem que existam barreiras eficazes para coibir tais abusos.

Para Cármen Lúcia, o regime de responsabilidade não pode se restringir aos danos causados pela presença do conteúdo - como previsto no art. 19 do marco civil da internet -, mas deve considerar o comportamento posterior das plataformas diante de decisões judiciais.

Segundo ela, o modelo atual falha ao não impedir a propagação transnacional de conteúdos ilícitos e ofensivos, que muitas vezes seguem sendo replicados mesmo após ordens judiciais determinando sua remoção.

Embora tenha reconhecido a liberdade de expressão como pilar essencial da democracia, Cármen Lúcia advertiu que essa garantia não pode ser usada para legitimar censura horizontal nem tampouco servir de escudo para ataques a direitos fundamentais.

Ao final, propôs interpretação conforme à Constituição para o art. 19 do Marco Civil da Internet, de modo a garantir a responsabilização das plataformas em casos de descumprimento de ordens judiciais - especialmente quando envolvam crimes contra a honra, o Estado Democrático de Direito e as liberdades públicas.

Validade do art. 19

Ministro Edson Fachin votou pela constitucionalidade do art. 19, manifestando-se contrariamente ao agravamento da responsabilidade civil das plataformas na ausência de ordem judicial específica.

Para o ministro, ainda que haja consenso na Corte sobre a necessidade de fortalecer a proteção aos direitos fundamentais no ambiente digital, esse reforço não pode comprometer o equilíbrio entre liberdade de expressão e responsabilidade civil.

Fachin alertou para os riscos de um controle indevido do discurso público, a erosão da pluralidade nas redes e a concentração de poder normativo nas mãos das próprias plataformas.

Defendeu que as soluções para os desafios trazidos pela internet devem ser buscadas no interior da "caixa de ferramentas da democracia", com respostas institucionais estruturais a serem formuladas pelo Legislativo.

No voto, traçou paralelo entre os modelos regulatórios norte-americano e europeu, e ressaltou que o art. 19 não constitui omissão normativa, mas representa uma escolha legítima do legislador brasileiro - capaz de estimular a moderação responsável sem comprometer a liberdade de expressão.

Fachin também demonstrou preocupação com a ampliação indevida do escopo do julgamento, advertindo que tal movimento poderia extrapolar os limites dos temas de repercussão geral e comprometer a segurança jurídica.

Devido processo digital

Nesta quinta-feira, 26, ministro Nunes Marques votou pela constitucionalidade do art. 19 do marco civil da internet, sustentando que a responsabilização civil das plataformas digitais por conteúdo de terceiros é, como regra, subsidiária, surgindo apenas em caso de descumprimento de ordem judicial específica.

Segundo o ministro, a liberdade de expressão é uma cláusula pétrea da CF e deve ser protegida inclusive quando desagrada ou incomoda determinados grupos, cabendo a repressão de eventuais excessos apenas a posteriori, por meio dos mecanismos legais já existentes.

Nunes Marques propôs ainda que as plataformas adotem um modelo interno de "devido processo legal digital", garantindo aos usuários notificados a possibilidade de esclarecimento e defesa antes de bloqueios ou exclusões de conteúdo ou perfis.

O ministro admitiu a possibilidade de remoção de conteúdo sem ordem judicial quando houver prova inequívoca de fraude, como no uso indevido de identidade ou imagem, com base nos direitos fundamentais à intimidade e à honra.

Por fim, ressaltou a competência do Congresso Nacional para discutir atualizações legais sobre o tema e negou provimento aos dois recursos extraordinários em julgamento.